YouTube é acusado de treinar sua IA com um novo prompt de vídeo perguntando “Isso parece um desperdício de IA?”

O YouTube acaba de lançar uma nova pesquisa pop-up perguntando aos espectadores se os vídeos parecem “resíduos de IA”, estimulando teorias de que eles estão treinando seu próprio bot. Desde terça-feira, em vez de perguntar se um vídeo é relevante para uma pesquisa, o YouTube agora às vezes solicita que o usuário compartilhe a classificação do clipe em seu medidor pessoal de detecção de IA.

As reações podem parecer paranóicas se você não souber o que outras empresas fizeram com seus dados.

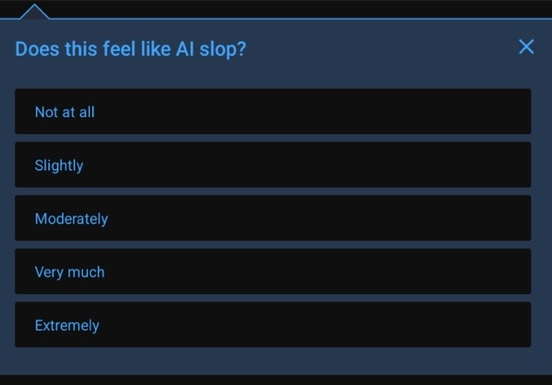

Avalie seu lixo no YouTube

A partir de 17 de março, os espectadores do YouTube começaram a ver um novo pop-up durante seus vídeos. “Isso parece um lixo de IA?” ele pergunta.

Os usuários podem rotular as vibrações do vídeo como algo entre “nada” ou “extremamente” desleixado.

Uma possível razão para esta mudança são as intenções declaradas da empresa de combater o influxo de conteúdo de baixa qualidade gerado com grandes modelos de linguagem (LLMs). Em janeiro, o CEO Neal Mohan classificou isso como uma prioridade para 2026 em sua carta anual ao YouTube.

“Está se tornando mais difícil detectar o que é real e o que é gerado pela IA”, disse ele. “Isso é particularmente crítico quando se trata de deepfakes.”

“Para reduzir a disseminação de conteúdo de IA de baixa qualidade, estamos desenvolvendo ativamente nossos sistemas estabelecidos que têm tido muito sucesso no combate a spam e clickbait e na redução da disseminação de conteúdo repetitivo e de baixa qualidade.”

Ao mesmo tempo, ele falou sobre a expansão do LLM do próprio YouTube para permitir aos usuários criar vídeos e até jogos simples com instruções de texto.

Esta carta veio na sequência de um relatório que concluiu que mais de 20 por cento do conteúdo do YouTube era lixo de IA no final de 2025.

O YouTube está lutando contra a IA ou treinando-a?

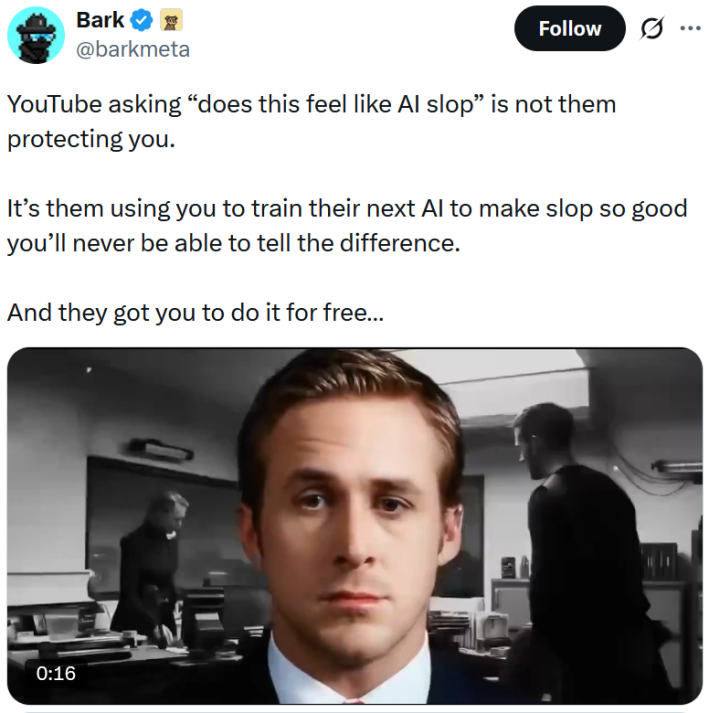

No X, o aplicativo “tudo exceto CSAM, prometemos desta vez”, pessoas bombardeadas por IA estão acusando o YouTube de nos usar não para treinar seu algoritmo para suprimir resíduos de baixa qualidade, mas para treinar sua IA para produzir resíduos de melhor qualidade.

“O YouTube perguntar ‘isso parece um lixo de IA’ não é a proteção deles”, escreveu @barkmeta. “São eles usando você para treinar sua próxima IA para tornar o lixo tão bom que você nunca será capaz de perceber a diferença.”

“E eles fizeram você fazer isso de graça.”

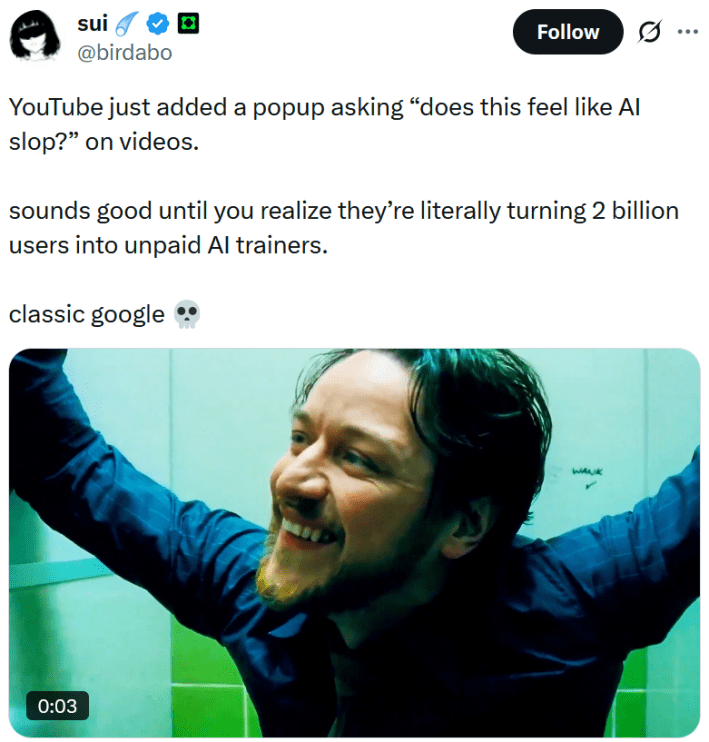

“O YouTube não está proibindo o desperdício de IA. Eles estão fazendo você rotulá-lo para que possam treinar seu próximo modelo para não parecer um lixo”, afirmou @TukiFromKL.

O usuário @birdabo lamentou que o novo prompt do YouTube “parece bom até você perceber que eles estão literalmente transformando 2 bilhões de usuários em treinadores de IA não remunerados”.

Muitas das pessoas que alimentam essa teoria são fãs de IA ou até mesmo os próprios desenvolvedores. De alguma forma, eles não gostam de pegar o trabalho dos outros e usá-lo para enriquecer sem crédito ou compensação.

Independentemente disso, faz sentido que os usuários modernos da Internet presumam que a questão do YouTube é outra tentativa de fazer com que todos nós treinemos uma IA sem saber. Em 2018, descobrimos que esses detectores de bots reCAPTCHA usavam as respostas e as habilidades de resolução de quebra-cabeças das pessoas para fazer exatamente isso.

O Google, proprietário do YouTube, também possui o reCAPTCHA.

Então, no fim de semana passado, surgiu a notícia de que a Niantic usou todas aquelas fotos fofas que tiramos no Pokémon Go para treinar bots de entrega de IA.

Não é de admirar que o termo “paranóia da IA” esteja começando a se tornar popular.

A Internet é caótica, mas vamos detalhar isso para você em um e-mail diário. Inscreva-se no boletim informativo do Daily Dot aqui.