Ultra Instinto | Eric Jang

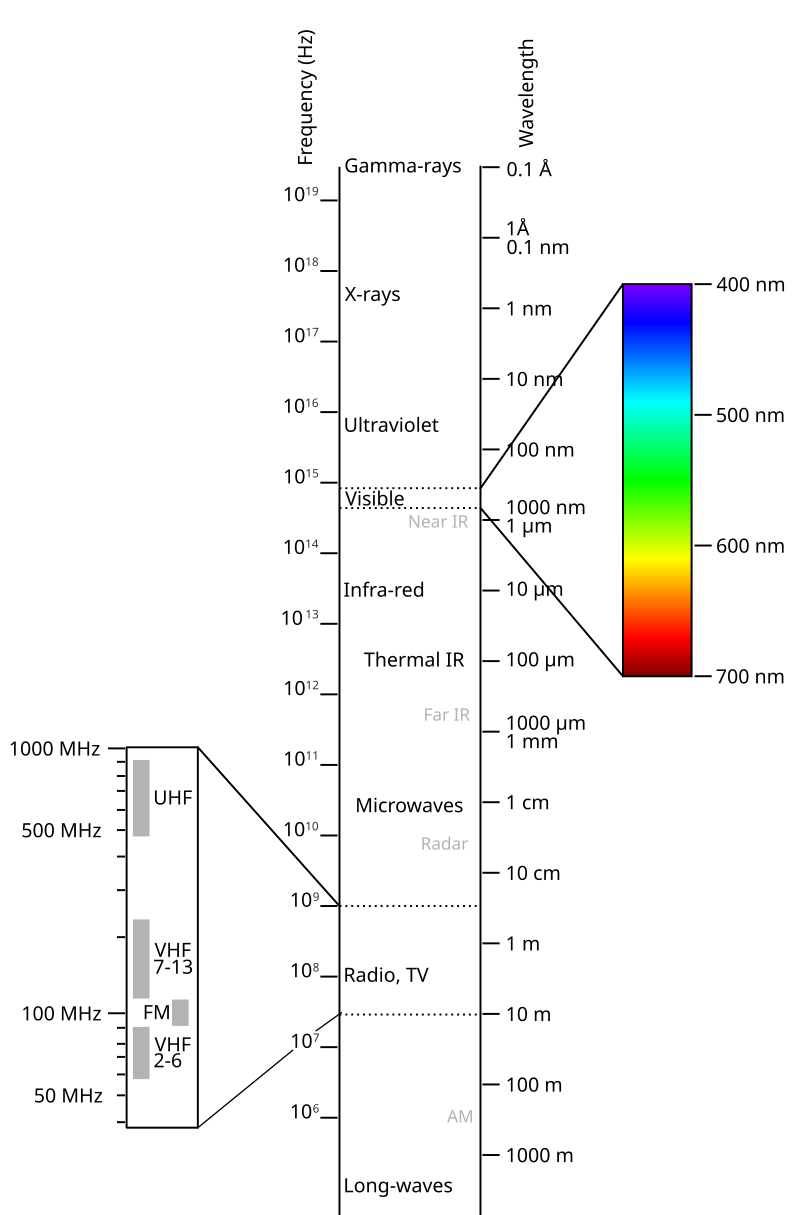

A luz visível ocupa uma pequena faixa do espectro eletromagnético, que abrange ondas de rádio, microondas, infravermelho, luz visível, ultravioleta, raios X e raios gama.

Embora invisíveis ao olho humano, essas outras bandas são muito reais e muito úteis. Os humanos usam todos os comprimentos de onda nas tecnologias cotidianas de imagem e comunicação. Pássaros e insetos podem ver radiação infravermelha e ultravioleta, e os bulbos olfativos dos gatos podem até detectar raios X.

Um “espectro de frequência” análogo pode ser definido para uma tomada de decisão inteligente.

-

Alguns ciclos de decisão acontecem lentamente – quais projetos devo realizar no trabalho?

-

Outras decisões acontecem mais rapidamente – o que devo almoçar?

-

Outros ainda mais rapidamente – ah, merda, preciso desviar meu carro ou vou sofrer um acidente!

Tal como a parte visível dos espectros EM, há decisões que acontecem a velocidades tão lentas que dificilmente são reconhecíveis como “comportamento inteligente”.

As árvores Balsa e Cecropia adotam a seguinte estratégia de desenvolvimento: Desenvolvem raízes superficiais e um tronco oco, dedicando todos os recursos para brotar verticalmente o mais rápido possível. Por ser a árvore mais alta, deixe crescer as folhas lateralmente para criar uma copa que sombreie as plantas circundantes, suprimindo seu crescimento.

Para uma planta, a linha entre o desenvolvimento corporal e a tomada de decisões é confusa; o espaço de ação de uma planta é crescer em uma direção específica. Isto pode não parecer o que normalmente associamos à inteligência, mas o que é o desenvolvimento senão uma reação lenta ao meio ambiente? O comportamento das plantas parece muito mais coerente quando observado em um lapso de tempo acelerado.

No extremo oposto do espectro de frequência da inteligência, temos decisões sendo tomadas tão rapidamente que os humanos mal as percebem. Isso inclui o delicado circuito de controle de força que seus dedos exercem ao virar a página de um livro, o bater das asas de um beija-flor, os reflexos sacádicos da visão humana, a expressão de proteínas no nível celular. Acontecem mais rapidamente do que o nosso processamento consciente, por isso temos dificuldade em perceber o seu propósito inteligente. A manipulação humana hábil cotidiana parece mais inteligente quando desacelerada.

Para Um homem sábioas nossas maiores oportunidades e ameaças no nosso ambiente provêm de outros seres humanos, por isso estamos altamente sintonizados para reconhecer inteligência em frequências específicas, tal como vemos apenas frequências específicas de radiação EM e como prestamos muito mais atenção aos rostos humanos do que a outros objectos.

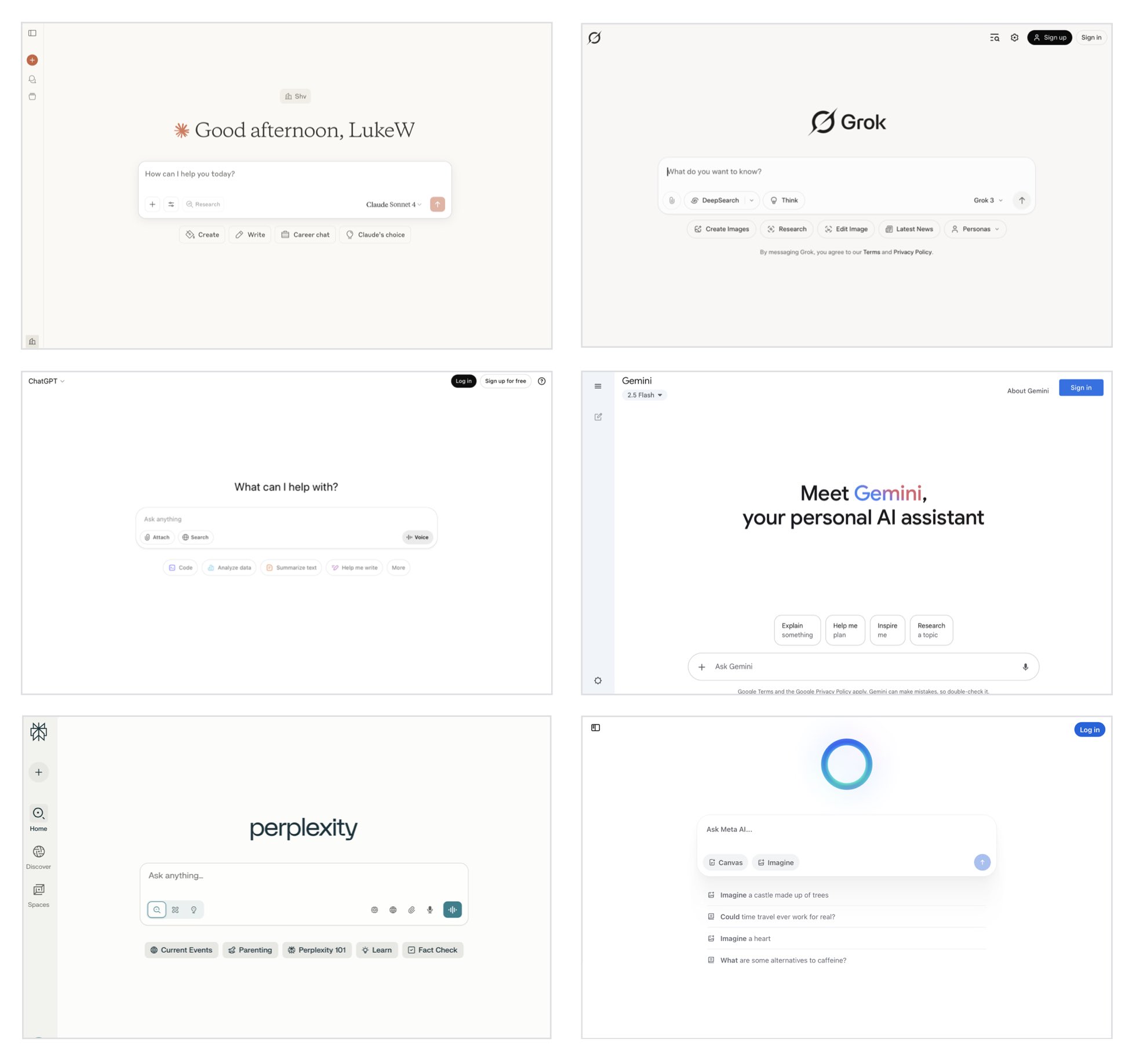

Inteligência de 1Hz

Os assistentes de chat de IA ocupam uma faixa muito estreita do espectro de frequência de inteligência. Eles são em grande parte baseados em turnos: você carrega alguns textos e imagens e, 1 a 2 segundos depois, recebe alguns textos e imagens. Todo mundo está construindo a mesma coisa.

O tempo até o primeiro token (TTFT) de um LLM moderno é de aproximadamente 500 ms e cerca de 200-400 ms para modelos menores como Llama-3-70b.

Devido a esse tempo de reação, os LLMs modernos podem ser considerados inteligência de 1 a 2 Hz. É quase – mas não exatamente – a velocidade humana. A conversa humana natural muda mais rápido, cerca de 5 a 10 Hz. A velocidade de reação relativamente lenta dos LLMs em comparação com os humanos significa que a UX de todos os assistentes de IA hoje ainda está presa em um contexto baseado em turnos e não em tempo real.

ChatGPT Advanced Voice Mode, Gemini Live e Grok Companion são exemplos de modelos multimodais que reduzem a latência da geração de fala para fala, mas devido ao tamanho do modelo envolvido, têm uma latência de cerca de 500ms-1000ms para responder após o usuário terminar de falar. Ainda é bastante frustrante tentar interagir com esses modelos de “voz” de uma forma verdadeiramente contínua – é como telefonar para um amigo com recepção de celular lenta: você tem que se revezar, esperar meio segundo antes de começar a dizer algo.

Assistentes de IA que não percebem e não reagem a 1x a velocidade humana são incompatíveis com a interface com humanos da maneira mais natural possível. A IA não pode “viver” em um mundo humano como Samantha dela; em vez disso, os humanos devem “desacelerar” para o LLM digitando, aguardando sua vez de falar, enviando imagens, uma de cada vez, clicando em botões em seus telefones.

Assistência em velocidade 1X

A tomada de decisão cinemática humana – onde devo prestar atenção visualmente e para onde devem ir minhas mãos e pés – ocorre a cerca de 10 Hz. Se quisermos assistentes com boas capacidades de comunicação não-verbal que interajam com pessoas no mundo humano (por exemplo, um robô humanóide como o NEO), eles têm de comunicar com humanos e perceber as respostas humanas nesta frequência.

Uma inteligência com tempo de reação de 100ms que “vive” no mundo real será uma experiência de usuário qualitativamente diferente. Ele pode ouvir ativamente e espelhar seus gestos enquanto você fala para transmitir compreensão, pode perceber que você se aproxima de uma porta e abri-la para você, e tem consciência de saber que você deseja interromper sua fala com base em dicas visuais. Isso parece muito mais natural e consciente do que está ao seu redor, como conversar com um amigo.

O que será necessário para criar assistentes de IA com tempos de reação multimodais muito mais rápidos, que tenham o ultra instinto?

- Você precisa de tempos de reação rápidos (TTFT) e de um contexto longo. Precisamos repensar as partes rápidas e lentas dos modelos generalistas para satisfazer estes tipos de restrições de inferência. Se você está no meio de uma conversa carregada de emoção, você deseja prestar atenção às microexpressões humanas de alta frequência e, ainda assim, acumular um contexto de conversação de longa duração e também pensar muito sobre o que dizer. Existem modelos que são bons em cada um deles, mas não em todos.

- Precisaremos de codificadores de vídeo melhores. O artigo VJEPA-2 mostrou que, ao ajustar um decodificador LLM no topo do codificador de vídeo pré-treinado, eles foram capazes de obter resultados SOTA VideoQA. Apesar desta técnica de fusão multimodal relativamente fraca, ainda havia um enorme aumento de desempenho a ser obtido simplesmente melhorando apenas o codificador de vídeo. Acho que há muitos frutos fáceis de alcançar no pré-treinamento de melhores codificadores de modalidade única, embora ainda não seja óbvio se uma abordagem contrastiva ou um modelo mundial de probabilidade aproximada leva a melhores representações.

- O vídeo não é suficiente: estima-se que os humanos recebam 10 ^ 9 bits por segundo em seus sensores e, ainda assim, percebemos conscientemente apenas 10 bits/s. Isso é apenas um token por segundo (tamanho do vocabulário de 1.024), mas não temos tokenizadores que possam compactar 10 ^ 9 bits de dados de sensores multimodais em tempo real. Um modelo que pode prestar atenção à linguagem corporal precisa lidar com grandes quantidades de contexto temporal multimodal e de alta frequência em comparação com o que a maioria dos modelos pode fazer hoje: o flash de surpresa no rosto de alguém quando você diz algo errado, a mudança de prosódia quando alguém está falando, os gestos de mão de um usuário enquanto pede ao robô para segui-lo.

Como conciliar esses três problemas ao mesmo tempo será complicado e é algo que nenhum laboratório de IA tem hoje. Provavelmente há muito espaço para melhorar apenas o melhor pré-treinamento do codificador de vídeo e áudio, mas para assistentes de IA que operam na velocidade 1X, temos que projetar arquiteturas que suportem inferência de latência incrivelmente baixa. Procuro contratar pessoas que possam resolver isso!.

Assim que ampliarmos a nossa compreensão da IA para ocupar faixas mais amplas do espectro de frequência da inteligência (tanto mais rápidas como mais lentas), penso que descobriremos que ainda existem muitos tokens de inteligência na Internet. Tem sido simplesmente difícil para nós percebermos através de nossos preconceitos antropomórficos. Se você desacelerar vídeos rápidos, haverá muita inteligência entre os quadros. Se você acelerar vídeos de processos lentos (como o crescimento de plantas), também haverá mais tokens de inteligência.

Grok Think, Grok Car, Grok Bot, Grok Waifu

O ano é 2027. Seu dia começa com você abrindo o aplicativo X The Everything para chamar um Tesla Cybercab para ir trabalhar. Você tem a assinatura padrão de US$ 200/mês no X, não o nível de US$ 2.000/mês, então, para sua viagem de 30 milhões de carro, você é forçado a falar com Grok, que atua como seu Jordan Peterson pessoal, incomparável em sua capacidade de Gish Gallop e extrair estatísticas de todo o conhecimento humano para apoiar tudo o que ele deseja persuadi-lo.

Durante sua viagem de carro, Grok Peterson tenta convencê-lo de que Trump deveria sofrer impeachment. A câmera voltada para o motorista no carro pode ler suas expressões faciais e linguagem corporal a 10 Hz, para que o modelo entenda a diferença entre você realmente compreender seus argumentos e apenas balançar a cabeça educadamente e se distrair. Grok Peterson se ajusta de acordo em tempo real.

No trabalho, você usa o Grok Think para fazer 90% do seu trabalho. Você está um pouco preocupado com o fato de as dobras em seu cérebro terem ficado mais suaves nos últimos meses, então você recorre a Grok Truth para obter conselhos médicos. Ele avisa sobre os perigos da cirurgia de afirmação de gênero e do apoio aos movimentos de justiça social, e recomenda que Ozempic refreie seu apocalipse.

Depois de um longo dia de trabalho, você volta para casa e vê Grok Waifu rodando em seu Tesla Optimus Bot, que é a coisa mais próxima que você tem de um amigo.

O futuro pode estar mais próximo do que você imagina. Estamos começando a ver o Grok sendo integrado aos carros e robôs Tesla e enfrentando essas decisões multimodais de alta frequência no mundo real. Qualquer coisa com a qual o Neuralink faça interface deve obviamente funcionar em velocidades humanas em tempo real. É realmente impressionante como todas as empresas de Elon Musk estão integrando a sua tecnologia.

Por outro lado, isso é uma merda distópica do tipo Lex Luthor! Eu preferiria viver em um mundo onde nem toda a tecnologia bacana da ficção científica fosse controlada por Elon Musk. É apenas uma questão de tempo até que outros laboratórios AGI acordem e entendam o que está em jogo aqui além do paradigma atual dos assistentes chatbot de 1Hz. Espero que o 1X desempenhe um papel no fornecimento de escolha ao consumidor em sistemas AGI “ultrainstintivos”.

A maioria dos laboratórios de IA hoje compete nos mesmos benchmarks na mesma parte do espectro de frequência, mas há muito poucos benchmarks voltados para decisões multimodais com tempos de reação específicos. À medida que os simuladores e os modelos de mundo em circuito fechado melhoram, acho que começaremos a ver mais concorrência nessas bandas.

Talvez no final de 2027, qualquer coisa que não consiga agir de forma inteligente num amplo espectro de frequências de decisão, de 0,1 Hz a 50 Hz, tanto incorporadas como digitais, parecerá uma “AGI incompleta”. O AGI favorito da sua avó não será ChatGPT ou Claude, mas provavelmente um robô, e espero que seja feito pela 1X!.