Raciocínio, codificação e abililias agênticas

GLM-4.5: Raciocínio, codificação e abililties Agentic. Outro dia, outro novo modelo de modelo de peso aberto significativo de um laboratório de AI de fronteira chinesa.

Desta vez, é Z.ai – quem renomeou (pelo menos em inglês) de Zhipu AI há alguns meses. Eles acabaram de lançar o GLM-4.5-BASE, GLM-4.5 e GLM-4.5 Ar no rosto abraçando, tudo sob uma licença do MIT.

Estes são modelos de raciocínio híbrido MOE com modos de pensamento e não pensamento, semelhantes ao QWEN 3. GLM-4.5 é de 355 bilhões de parâmetros totais com 32 bilhões de ativos, o GLM-4.5-AIR é 106 bilhões de parâmetros totais e 12 bilhões de ativos.

Eles começaram a usar o MIT há alguns meses para seus modelos GLM-4-0414-seus lançamentos mais antigos usaram uma licença personalizada sem origem aberta.

O próprio benchmarking da Z.Ai (em 12 benchmarks comuns) classificou seu GLM-4.5 3º atrás da O3 e Grok-4 e logo à frente do Claude Opus 4. Eles classificaram o Glm-4.5 Air em 6º lugar logo à frente de Claude 4 Sonnet. Ainda não vi nenhum benchmark independente.

Os outros modelos que eles incluíram em seus próprios parâmetros de referência foram O4-mini (alta), Gemini 2.5 Pro, Qwen3-235b-Thinking-2507, Deepseek-R1-0528, Kimi K2, GPT-4.1, Deepseek-V3-0324. Notavelmente ausente: qualquer um dos modelos de llama da Meta, ou qualquer um dos Mistral. Eles deliberadamente se compararam apenas para abrir modelos de peso de outros laboratórios de IA chineses?

Ambos os modelos têm um comprimento de 128.000 contexto e são treinados para chamadas de ferramentas, o que honestamente parece apostas de mesa para qualquer modelo lançado em 2025 neste momento.

É interessante vê -los usar o código Claude para executar seus próprios benchmarks de codificação:

Para avaliar os recursos de codificação agêntica do GLM-4.5, utilizamos o código Claude para avaliar o desempenho em relação ao codificador Claude-4, Kimi K2 e QWEN3-Coder em 52 tarefas de codificação que abrangem o desenvolvimento do front-end, o desenvolvimento de ferramentas, a análise de dados, o teste e a implementação do algoritmo. (…) Os resultados empíricos demonstram que o GLM-4.5 atinge uma taxa de vitória de 53,9% contra o Kimi K2 e exibe desempenho dominante sobre o QWEN3-Coder com uma taxa de sucesso de 80,8%. Embora o GLM-4.5 mostre um desempenho competitivo, mais oportunidades de otimização permanecem quando comparadas ao Claude-4 Sonet.

Eles publicaram o conjunto de dados para esse benchmark como Zai-Org/CC-Bench Trajetórias em abraçar o rosto. Eu acho que eles estão usando a palavra “trajetória” para o que eu chamaria de transcrição de bate -papo.

Ao contrário do Deepseek-V3 e Kimi K2, reduzimos a largura (dimensão oculta e número de especialistas roteados) do modelo enquanto aumentam a altura (número de camadas), pois descobrimos que modelos mais profundos exibem melhor capacidade de raciocínio.

Eles pré-treinados em 15 trilhões de fichas, depois mais 7 trilhões para código e raciocínio:

Nosso modelo básico passa por vários estágios de treinamento. Durante o pré-treinamento, o modelo é treinado pela primeira vez em tokens 15T de um corpus pré-treinamento geral, seguido por 7T tokens de um corpus de código e raciocínio. Após o pré-treinamento, introduzimos estágios adicionais para melhorar ainda mais o desempenho do modelo nos principais domínios a jusante.

Eles também abriram seu arnês de aprendizado de reforço pós-treinamento, que eles chamaram lodo. Isso está disponível na Thudm/Slime no Github – Thudm é o grupo de engenheiros de conhecimento @ Tsinghua University, a universidade da qual Zhipu AI se dividiu como uma empresa independente.

Desta vez, executei meu Pelican Bechmark usando a interface de bate -papo chat.z.ai, que oferece acesso gratuito (não é necessária uma conta) ao ar GLM 4.5 e GLM 4.5. Eu tinha raciocínio ativado para ambos.

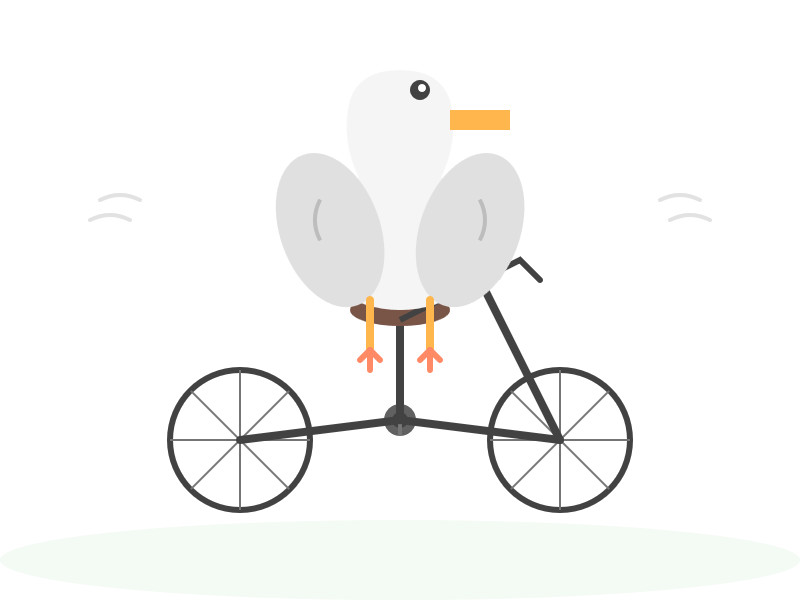

Aqui está o que eu recebi para “gerar um SVG de um pelicano andando de bicicleta” no GLM 4.5. Eu gosto de como o pelicano tem suas asas no guidão:

E GLM 4.5 ar:

Ivan Fioravanti compartilhou um vídeo do modelo quantizado MLX-Community/GLM-4.5-Air-4bit em execução em um M4 Mac com 128 GB de RAM, e parece um candidato muito forte para um modelo local que pode escrever um código útil. O estúdio MAC mais barato de 128 GB custa cerca de US $ 3.500 no momento, então os modelos de codificação de peso aberto genuinamente grandes estão se aproximando de serem acessíveis em máquinas de consumo.

Atualizar: Ivan lançou uma versão quantizada de 3 bits do Air GLM-4.5, que funciona usando 48 GB de RAM no meu laptop. Eu tentei e fui realmente Impressionado, veja meu laptop de 2,5 anos pode escrever invasores de espaço em JavaScript agora.