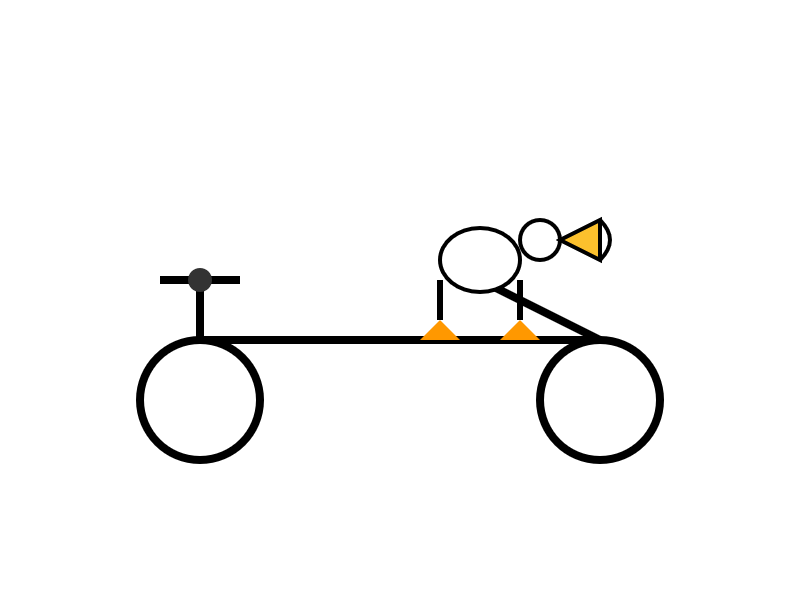

QWEN3-NEXT-80B-A3B: 🐧🦩 Quem precisa de pernas?!

QWEN3-NEXT-80B-A3B. Qwen anunciou dois novos modelos por meio de sua conta do Twitter (e aqui está o blog deles): QWEN3-NEXT-80B-A3B-Instruct e QWEN3-NEXT-80B-A3B-Pensamento.

Eles fazem algumas grandes reivindicações sobre o desempenho:

- O QWEN3-NEXT-80B-A3B-INSTRUTA se aproxima do nosso carro-chefe de 235B.

- O QWEN3-NEXT-80B-A3B-PINCULING SUPLOTEMPLA DE AMOU GEMINI -2.5-FLASH-PINCULING.

O nome “80B-A3B” indica 80 bilhões de parâmetros, dos quais apenas 3 bilhões estão ativos por vez. Você ainda precisa ter um RAM acessível a GPU suficiente para manter todos os 80 bilhões de memória de uma só vez, mas apenas 3 bilhões serão usados para cada rodada de inferência, que fornece um significativo acelerar na resposta a instruções.

Mais detalhes de seu tweet:

- Parâmetros 80b, mas apenas 3b ativado por token → 10x treinamento mais barato, 10x inferência mais rápida que Qwen3-32b. (Esp. @ 32K+ Contexto!)

- Arquitetura híbrida: deltanet fechado + atenção fechada → Best of Speed & Recall

- Ultra Sparse Moe: 512 especialistas, 10 roteados + 1 compartilhado

- Previsão com vários toques → Decodificação especulativa com carga turbo

- Beats qwen3-32b em perf, rivais QWEN3-235B em raciocínio e contexto de longa data

Os modelos em abraçar o rosto têm cerca de 150 GB cada, então eu decidi experimentá -los via OpenRouter, em vez de no meu próprio laptop (pensando, instruir).

Eu sou usado meu plugin LLM-OpenRouter. Eu instalei assim:

llm install llm-openrouter

llm keys set openrouter

# paste key here

Em seguida, encontrei os IDs do modelo com este comando:

llm models -q next

Qual saída:

OpenRouter: openrouter/qwen/qwen3-next-80b-a3b-thinking

OpenRouter: openrouter/qwen/qwen3-next-80b-a3b-instruct

Eu tenho um modelo de prompt llm salvo chamado pelican-svg que eu criei assim:

llm "Generate an SVG of a pelican riding a bicycle" --save pelican-svg

Isso significa que eu posso executar meu benchmark Pelican assim:

llm -t pelican-svg -m openrouter/qwen/qwen3-next-80b-a3b-thinking

Ou assim:

llm -t pelican-svg -m openrouter/qwen/qwen3-next-80b-a3b-instruct

Aqui está a saída do modelo de pensamento (exportado com llm logs -c | pbcopy Depois que eu executei o prompt):

Gostei do “estilo caprichoso com curvas suaves e proporções amigáveis (nenhuma precisão anatômica necessária para passear de bicicleta!) Nota” na transcrição.

O modelo Instruct (não raciocínio) me deu o seguinte:

“Quem precisa de pernas!?” de fato! Eu gosto daquela sequência de emoji de pinguim-flamingo, é decidida para os pelicanos.