Por quanto tempo o seu vídeo grande modelo pode ir?

Timescope: Por quanto tempo o seu vídeo grande modelo multimodal pode ir? (Via) Novo benchmark de código aberto para avaliar o Vision LLMS sobre como eles lidam com vídeos longos:

Timescope sonde os limites das capacidades de longa data, inserindo vários curtos (~ 5-10 segundos) videoclipes— Nossas “agulhas” — em vídeos básicos que variam de 1 minuto a 8 horas. Com três tipos de tarefas distintos, ele avalia não apenas a recuperação, mas a síntese, a localização e a análise de movimento de granulação fina, proporcionando uma visão mais holística da compreensão temporal.

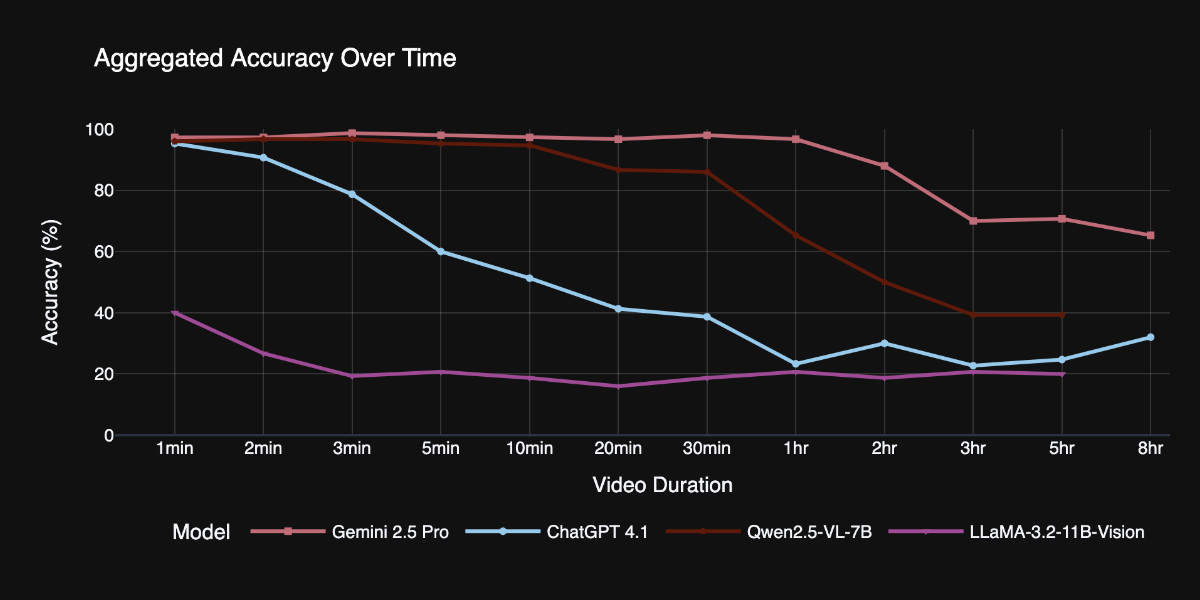

Os vídeos podem ser alimentados em modelos que aceitam imagens, convertendo-os em milhares de imagens de quadros (um truque que eu tentei), para que eles pudessem executar a referência contra modelos que incluíam GPT 4.1, QWEN2.5-VL-7B e LLAMA-3.2 11B Além dos modelos de suporte a vídeo como Gemini 2.5 Pro.

Duas descobertas da referência que se destacaram para mim:

O tamanho do modelo não é tudo. QWEN 2.5-VL 3B e 7B, bem como os modelos Internvl 2.5 a 2B, 4B e 8B parâmetros, exibem curvas quase indistinguíveis de longo dos vídeos para seus colegas menores. Todos eles no platô com aproximadamente o mesmo comprimento de contexto, mostrando que simplesmente os parâmetros de escala não concede automaticamente um horizonte temporal mais longo.

Gemini 2.5-Pro está em uma liga própria. É o único modelo que mantém forte precisão nos vídeos por mais de uma hora.

Você pode explorar o conjunto de dados de benchmark em abraçar o rosto, que inclui prompts como este:

Answer the question based on the given video. Only give me the answer and do not output any other words.

Question: What does the golden retriever do after getting out of the box?A: lies on the ground B: kisses the man C: eats the food D: follows the baby E: plays with the ball F: gets back into the box