Engenharia de Contexto Estruturado para Sistemas Agentes Nativos de Arquivos

Engenharia de Contexto Estruturado para Sistemas Agentes Nativos de Arquivos (através de) Novo artigo de Damon McMillan explorando tarefas desafiadoras de contexto de LLM envolvendo grandes esquemas SQL (até 10.000 tabelas) em diferentes modelos e formatos de arquivo:

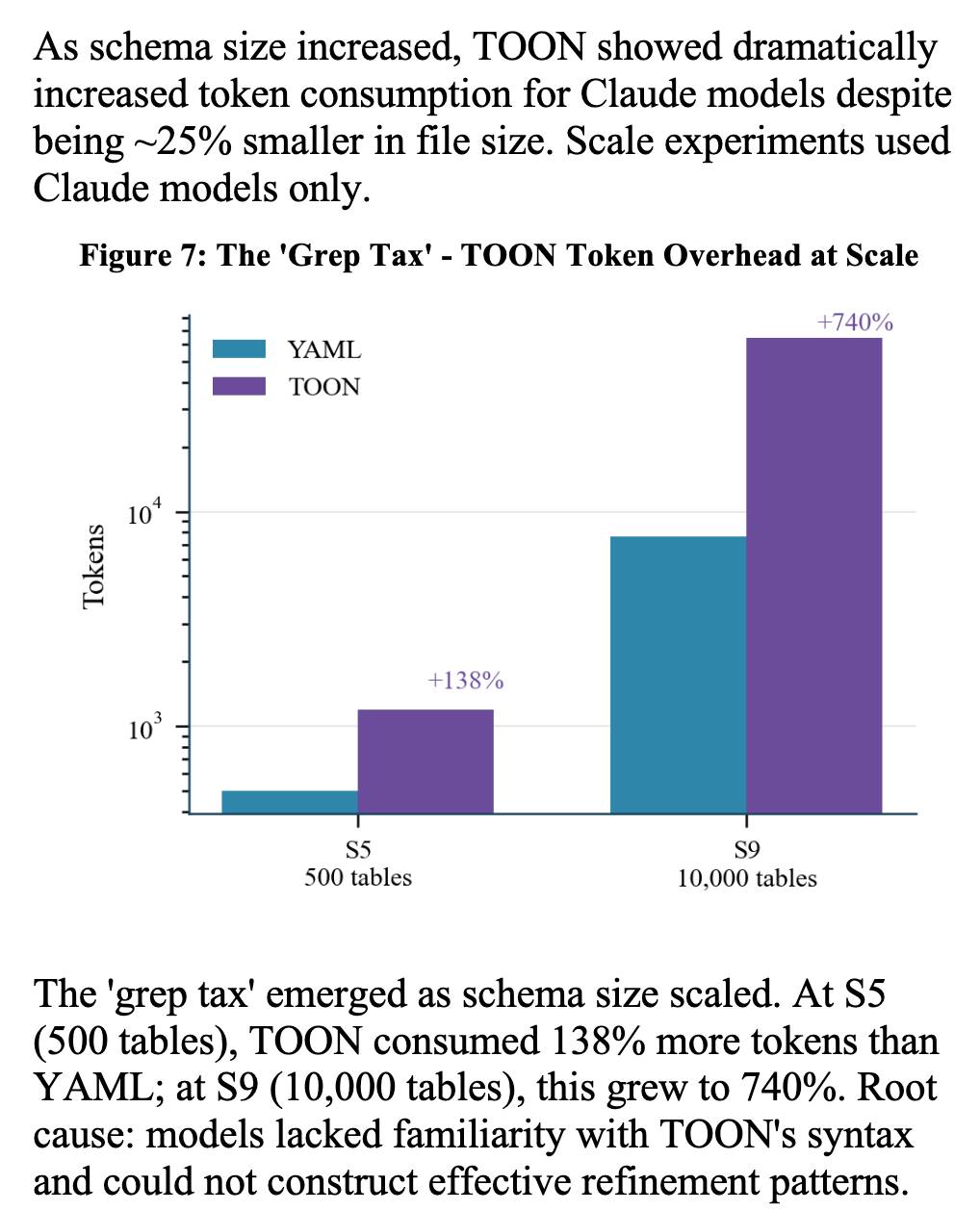

Usando a geração SQL como proxy para operações de agentes programáticos, apresentamos um estudo sistemático de engenharia de contexto para dados estruturados, compreendendo 9.649 experimentos em 11 modelos, 4 formatos (YAML, Markdown, JSON, Token-Oriented Object Notation (TOON)) e esquemas variando de 10 a 10.000 tabelas.

Sem surpresa, o maior impacto foram os próprios modelos – com modelos de fronteira (Opus 4.5, GPT-5.2, Gemini 2.5 Pro) superando os principais modelos de código aberto (DeepSeek V3.2, Kimi K2, Llama 4).

Esses modelos de fronteira se beneficiaram da recuperação de contexto baseada no sistema de arquivos, mas os modelos de código aberto tiveram resultados muito menos convincentes com eles, o que reforça minha sensação de que os loops do agente de codificação do sistema de arquivos ainda não são tratados tão bem pelos modelos de peso aberto. A tabela de classificação do Terminal Bench 2.0 ainda é dominada por Anthropic, OpenAI e Gemini.

O resultado do “grep tax” contra o TOON foi um detalhe interessante. O objetivo do TOON é representar dados estruturados no menor número possível de tokens, mas acontece que a falta de familiaridade do modelo com esse formato os levou a gastar significativamente mais tokens em várias iterações tentando descobrir: