Claude Opus 4.5, e por que avaliar novos LLMs é cada vez mais difícil

Claude Opus 4.5, e por que avaliar novos LLMs é cada vez mais difícil

24 de novembro de 2025

A Anthropic lançou Claude Opus 4.5 esta manhã, que eles chamam de “melhor modelo do mundo para codificação, agentes e uso de computador”. Esta é a tentativa deles de retomar a coroa de melhor modelo de codificação após desafios significativos do GPT-5.1-Codex-Max da OpenAI e do Gemini 3 do Google, ambos lançados na semana passada!

As principais características do Opus 4.5 são um contexto de 200.000 tokens (igual ao Sonnet), limite de saída de 64.000 tokens (também o mesmo do Sonnet) e um “limite de conhecimento confiável” de março de 2025 (Sonnet 4.5 é janeiro, Haiku 4.5 é fevereiro).

O preço é um grande alívio: US$ 5/milhão para insumos e US$ 25/milhão para produção. Isso é muito mais barato que o Opus anterior, custando US$ 15/US$ 75, e o mantém um pouco mais competitivo com a família GPT-5.1 (US$ 1,25/US$ 10) e Gemini 3 Pro (US$ 2/US$ 12 ou US$ 4/US$ 18 para> 200.000 tokens). Para efeito de comparação, o Soneto 4.5 custa US$ 3/US$ 15 e o Haiku 4.5 custa US$ 4/US$ 20.

Tive acesso a uma prévia do novo modelo da Anthropic no fim de semana. Passei muito tempo com ele no Claude Code, resultando em uma nova versão alfa do sqlite-utils que incluía diversas refatorações em larga escala — o Opus 4.5 foi responsável pela maior parte do trabalho em 20 commits, 39 arquivos alterados, 2.022 adições e 1.173 exclusões em um período de dois dias.

É claramente um novo modelo excelente, mas encontrei um problema. Minha visualização expirou às 20h de domingo, quando eu ainda tinha alguns problemas restantes no marco do alfa. Voltei para o Claude Sonnet 4.5 e… continuei trabalhando no mesmo ritmo que vinha conseguindo com o novo modelo.

Em retrospectiva, uma codificação de produção como essa é uma forma menos eficaz de avaliar os pontos fortes de um novo modelo do que eu esperava.

Não estou dizendo que o novo modelo não seja uma melhoria em relação ao Sonnet 4.5 – mas não posso dizer com segurança que os desafios que lhe apresentei foram capazes de identificar uma diferença significativa nas capacidades entre os dois.

Isso representa um problema crescente para mim. Meus momentos favoritos na IA são quando um novo modelo me dá a capacidade de fazer algo que simplesmente não era possível antes. No passado, estes pareciam muito mais óbvios, mas hoje é muitas vezes muito difícil encontrar exemplos concretos que diferenciem a nova geração de modelos dos seus antecessores.

O modelo de geração de imagens Nano Banana Pro do Google foi notável porque sua capacidade de renderizar infográficos utilizáveis realmente representa uma tarefa na qual os modelos anteriores eram ridiculamente incapazes.

Os LLMs de fronteira são muito mais difíceis de diferenciar. Benchmarks como o banco verificado mostram modelos superando uns aos outros por margens de pontos percentuais de um dígito, mas o que isso realmente significa em problemas do mundo real que preciso resolver diariamente?

E, honestamente, isso depende principalmente de mim. Fiquei para trás na manutenção da minha própria coleção de tarefas que estão um pouco além das capacidades dos modelos de fronteira. Eu costumava ter um monte desses, mas eles caíram um por um e agora estou vergonhosamente carente de desafios adequados para ajudar a avaliar novos modelos.

Freqüentemente aconselho as pessoas a guardarem em suas anotações as tarefas nas quais os modelos falham, para que possam testá-las em modelos mais recentes mais tarde – uma dica que aprendi com Ethan Mollick. Eu mesmo preciso repetir esse conselho!

Eu adoraria ver laboratórios de IA como o Anthropic ajudando a enfrentar esse desafio diretamente. Eu gostaria de ver lançamentos de novos modelos acompanhados de exemplos concretos de tarefas que eles podem resolver e que a geração anterior de modelos do mesmo fornecedor não conseguiu realizar.

“Aqui está um exemplo de prompt que falhou no Sonnet 4.5, mas teve sucesso no Opus 4.5” me entusiasmaria muito muito mais do que uma melhoria percentual de um dígito em um benchmark com um nome como MMLU ou GPQA Diamond.

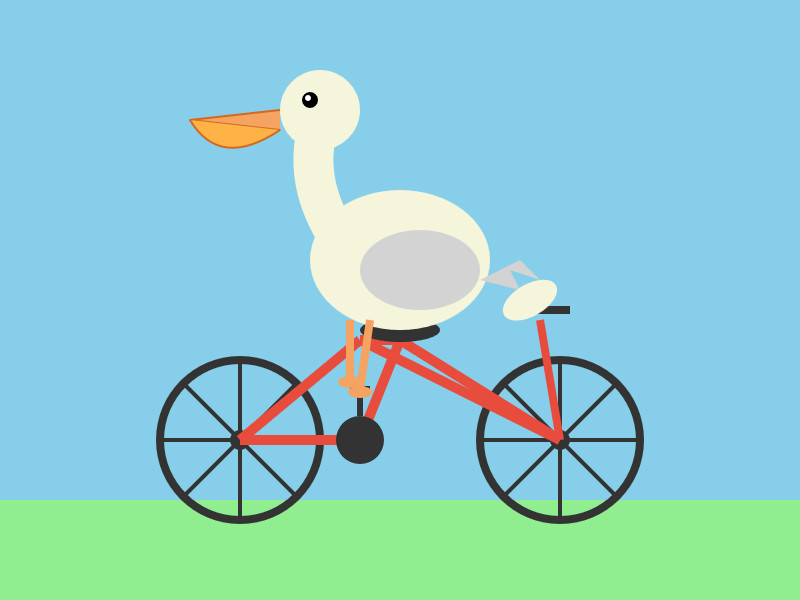

Enquanto isso, vou ter que continuar fazendo com que desenhem pelicanos andando de bicicleta. Aqui está o Opus 4.5 (em seu nível de esforço “alto” padrão):

O desempenho foi significativamente melhor no novo prompt mais detalhado: