Apresentando o GPT‑5.3‑Codex‑Spark

Apresentando o GPT‑5.3‑Codex‑Spark. A OpenAI anunciou parceria com a Cerebras no dia 14 de janeiro. Quatro semanas depois já estão lançando a primeira integração, “um modelo ultrarrápido para codificação em tempo real no Codex”.

Apesar de ser denominado GPT-5.3-Codex-Spark, não é puramente uma alternativa acelerada ao GPT-5.3-Codex – a postagem do blog o chama de “uma versão menor do GPT-5.3-Codex” e esclarece que “no lançamento, o Codex-Spark tem uma janela de contexto de 128k e é somente texto.”

Tive acesso prévio a este modelo e posso confirmar que ele é significativamente mais rápido do que os outros modelos.

Esta é a aparência dessa velocidade em execução no Codex CLI:

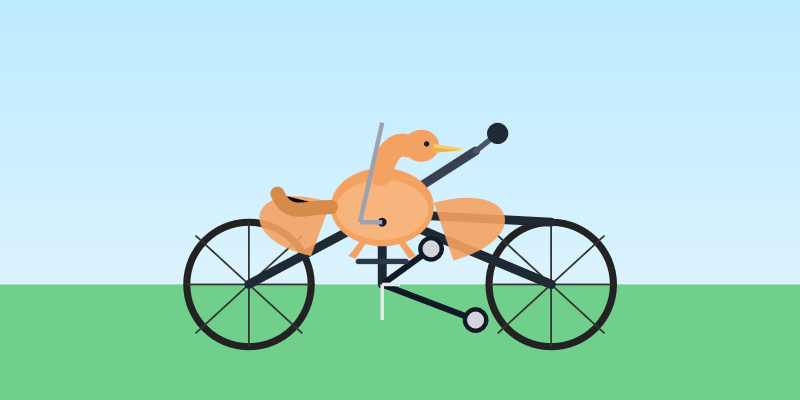

Esse foi o prompt “Gerar um SVG de um pelicano andando de bicicleta” – aqui está o resultado renderizado:

Compare isso com a velocidade do meio Codex GPT-5.3 normal:

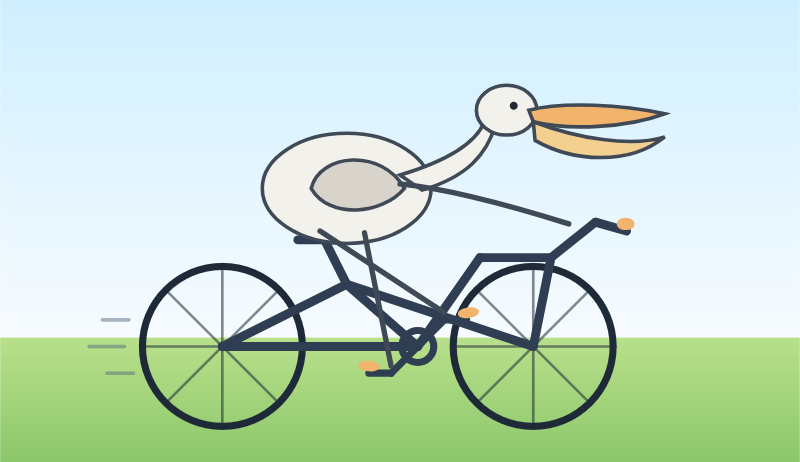

Significativamente mais lento, mas o pelicano é muito melhor:

O que é interessante neste modelo não é a qualidade, é o velocidade. Quando um modelo responde tão rápido, você pode permanecer no estado de fluxo e iterar com o modelo de forma muito mais produtiva.

Mostrei uma demonstração do Cerebras executando o Llama 3.1 70 B a 2.000 tokens/segundo contra Val Town em outubro de 2024. OpenAI reivindica 1.000 tokens/segundo para seu novo modelo, e espero que ele prove ser um parceiro extremamente útil para sessões práticas de codificação iterativa.