Desempenho de medalha de ouro da Openai na Olimpíada Internacional de Matemática

Desempenho de medalha de ouro da Openai na Olimpíada Internacional de Matemática. Isso parece notável para mim. O cientista da OpenAI Research Alexander Wei:

Estou animado para compartilhar que nosso mais recente @openai experimental raciocínio LLM alcançou um grande desafio de longa data na AI: desempenho no nível da medalha de ouro na competição de matemática de maior prestígio do mundo-a International Math Olympiad (IMO).

Avaliamos nossos modelos nos problemas de 2025 IMO nas mesmas regras que os concorrentes humanos: duas sessões de exame de 4,5 horas, sem ferramentas ou internet, lendo as declarações oficiais do problema e escrevendo provas de linguagem natural. (…)

Além do resultado em si, estou empolgado com a nossa abordagem: alcançamos esse nível de capacidade não por meio de metodologia estreita e específica da tarefa, mas abrindo novos caminhos no aprendizado de reforço de uso geral e no escala de computação no tempo de teste.

Em nossa avaliação, o modelo resolveu 5 dos 6 problemas na IMO de 2025. Para cada problema, três ex -medalhistas da IMO classificaram independentemente a prova enviada do modelo, com as pontuações finalizadas após consenso unânime. O modelo ganhou 35/42 pontos no total, o suficiente para o ouro!

Enorme parabéns à equipe – Sheryl Hsu, Noam Brown e os muitos gigantes cujos ombros nos deparamos – para transformar esse sonho louco em realidade! Tenho sorte de passar a noite e as manhãs trabalhando ao lado do melhor.

Aliás, estamos lançando o GPT-5 em breve e estamos empolgados por você experimentar. Mas apenas para ficar claro: o IMO Gold LLM é um modelo de pesquisa experimental. Não planejamos liberar nada com esse nível de capacidade matemática por vários meses.

(Normalmente, eu apenas vinculava o tweet, mas neste caso Alexander construiu um tópico … e os threads do Twitter não funcionam mais para vincular, pois são visíveis apenas para usuários com uma conta ativa do Twitter.)

Aqui está a Wikipedia na Olimpíada Matemática Internacional:

É amplamente considerado a competição matemática de maior prestígio do mundo. A primeira IMO foi realizada na Romênia em 1959. Desde então, foi realizada anualmente, exceto em 1980. Mais de 100 países participam. Cada país envia uma equipe de até seis estudantes, além de um líder de equipe, um vice -líder e observadores.

O evento deste ano é em Sunshine Coast, Austrália. Aqui está a página da web para o evento, que inclui um botão que você pode clicar para acessar um PDF das seis perguntas – talvez elas não vinculem a esse documento diretamente para desencorajá -lo a serem indexadas.

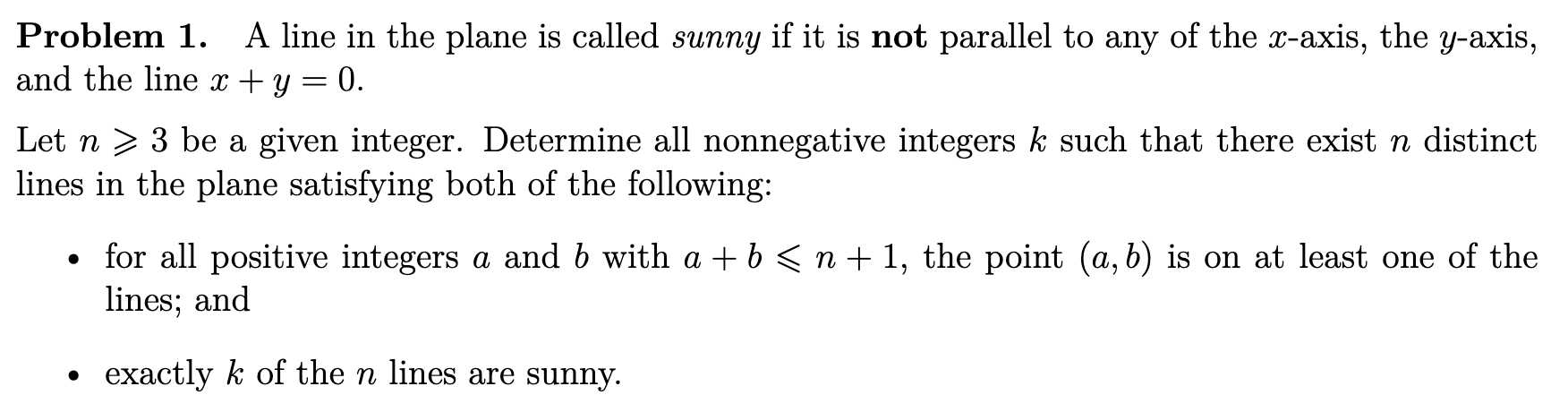

A primeira das seis perguntas é assim:

Alexander compartilhou as provas produzidas pelo modelo no Github. Eles estão em um formato um pouco estranho – não muito matemática incorporada em Markdown – que Alexander desculpa, já que “é um modelo experimental”.

O mais notável sobre isso é que o modelo sem nome alcançou esta pontuação sem usar nenhuma ferramenta. Sebastien Bubeck, do Openai, enfatiza isso aqui:

Apenas para soletrar o mais claramente possível: uma máquina de previsão da próxima palavra (porque é realmente o que é aqui, sem ferramentas não nada) apenas produziu provas genuinamente criativas para novos problemas matemáticos difíceis em um nível alcançado apenas por um punhado de elite de prodigies pré-colhere.

Há um monte de contexto mais útil neste tópico de Noam Brown, incluindo uma nota de que esse modelo não foi treinado especificamente para problemas da IMO:

Normalmente, para esses resultados de IA, como em Go/dota/poker/diplomacia, os pesquisadores passam anos fazendo uma IA que domina um domínio estreito e faz pouco mais. Mas este não é um modelo específico da IMO. É um LLM de raciocínio que incorpora novas técnicas experimentais de uso geral.

Então, o que é diferente? Desenvolvemos novas técnicas que tornam o LLMS muito melhor em tarefas difíceis de verificar. Os problemas da IMO foram o desafio perfeito para isso: as provas têm páginas e levam as horas de especialistas para classificar. Compare isso com o AIME, onde as respostas são simplesmente um número inteiro de 0 a 999.

Também este modelo pensa para um longo tempo. O1 pensou por segundos. Pesquisa profunda por minutos. Este pensa por horas. É importante ressaltar que também é mais eficiente com seu pensamento. E há muito espaço para empurrar ainda mais a computação e a eficiência do tempo de teste.

Vale a pena refletir sobre a rapidez com que o progresso da IA foi, especialmente em matemática. Em 2024, os laboratórios de IA estavam usando matemática escolar (GSM8K) como uma avaliação em seus lançamentos de modelo. Desde então, saturamos a referência matemática (do ensino médio), depois Aime, e agora estamos na IMO Gold. (…)

Quando você trabalha em um laboratório de fronteira, geralmente sabe onde os recursos da Frontier estão meses antes de mais ninguém. Mas esse resultado é novo, usando técnicas desenvolvidas recentemente. Foi uma surpresa até para muitos pesquisadores do Openai. Hoje, todo mundo consegue ver onde está a fronteira.