Atualização da tabela de classificação do SWE-bench de fevereiro de 2025

19 de fevereiro de 2026

Atualização da tabela de classificação do SWE-bench de fevereiro de 2025 (através de) SWE-bench é um dos benchmarks que os laboratórios adoram listar em seus lançamentos de modelos. A tabela de classificação oficial raramente é atualizada, mas eles apenas fizeram uma avaliação completa dela em relação à geração atual de modelos, o que é notável porque é sempre bom ver resultados de benchmark como este que não eram auto-relatado pelos laboratórios.

Os novos resultados são para seu benchmark “Bash Only”, que executa seu agente mini-swe-bench (~9.000 linhas de Python, aqui estão os prompts que eles usam) contra o conjunto de dados de problemas de codificação do SWE-bench – 2.294 exemplos do mundo real extraídos de 12 repositórios de código aberto: django/django (850), sympy/sympy (386), scikit-learn/scikit-learn (229), sphinx-doc/sphinx (187), matplotlib/matplotlib (184), pytest-dev/pytest (119), pydata/xarray (110), astropia/astropia (95), pylint-dev/pylint (57), psf/requests (44), mwaskom/seaborn (22), paletes/frasco (11).

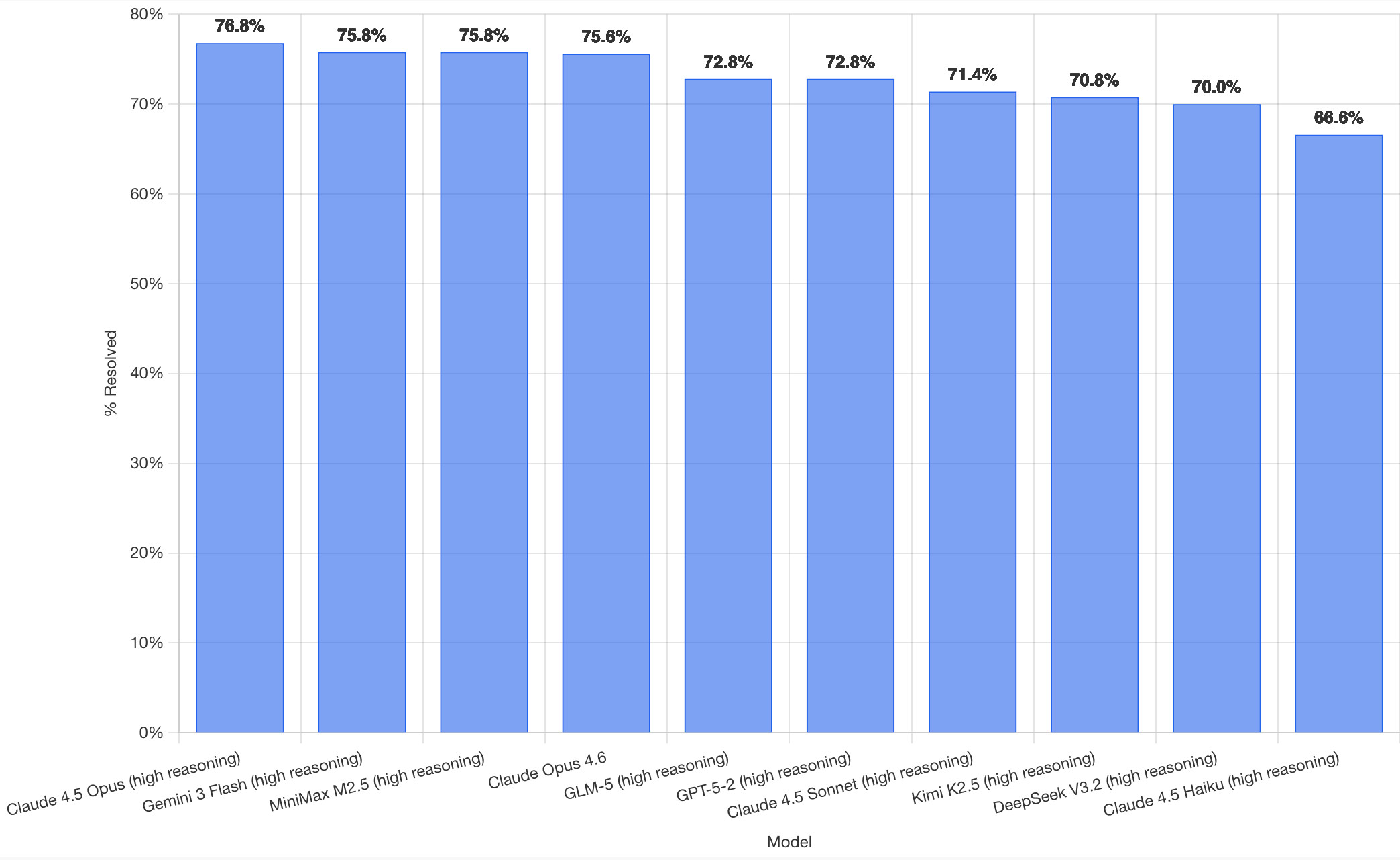

Veja o desempenho dos dez principais modelos:

É interessante ver Claude Opus 4.5 vencer o Opus 4.6, embora apenas por cerca de um ponto percentual. O 4.5 Opus é o melhor, depois o Gemini 3 Flash e depois o MiniMax M2.5 – um modelo 229B lançado na semana passada pelo laboratório chinês MiniMax. GLM-5, Kimi K2.5 e DeepSeek V3.2 são mais três modelos chineses que também estão entre os dez primeiros.

O GPT-5.2 da OpenAI é o modelo de melhor desempenho na posição 6, mas é importante notar que seu melhor modelo de codificação, GPT-5.3-Codex, não está representado – talvez porque ainda não esteja disponível na API OpenAI.

Este benchmark utiliza o mesmo prompt do sistema para cada modelo, o que é importante para uma comparação justa, mas significa que a qualidade dos diferentes chicotes ou prompts otimizados não está sendo medida aqui.

O gráfico acima é uma captura de tela do site SWE-bench, mas seus gráficos não incluem os valores percentuais reais visíveis nas barras. Usei com sucesso o Claude for Chrome para adicioná-los – transcrição aqui. Minha sequência de prompt incluiu:

Use claude no chrome para abrir https://www.swebench.com/

Clique em “Comparar resultados” e selecione “Selecionar os 10 primeiros”

Veja esses gráficos de barras? Quero que eles exibam a porcentagem em cada barra para que eu possa fazer uma captura de tela melhor e modificar a página assim

Estou impressionado com o quão bem isso funcionou – Claude injetou JavaScript personalizado na página para desenhar rótulos adicionais no gráfico existente.