Modelos de vídeo são alunos e raciocínio zero tiro

Modelos de vídeo são alunos e raciocínio zero tiro. O novo artigo fascinante do Google DeepMind, que defende muito o seu modelo de VEO 3 – e os modelos de vídeo generativos em geral – desempenham um papel semelhante no ecossistema visual de aprendizado de máquina, como o LLMS faz para o texto.

O LLMS adotou a capacidade de prever o próximo token e o transformou em modelos de fundação de uso geral para todos os tipos de tarefas que costumavam ser tratadas por modelos dedicados – resumo, tradução, partes da marcação de fala etc. agora podem ser tratados por modelos enormes, que estão ficando mais poderosos e mais baratos à medida que o tempo avança.

Modelos de vídeos generativos como o VEO 3 podem muito bem desempenhar o mesmo papel para tarefas de raciocínio de visão e imagem.

Do papel:

Acreditamos que os modelos de vídeo se tornarão modelos de fundação unificadores e de uso geral para visão de máquina, assim como modelos de idiomas grandes (LLMs) se tornaram modelos de fundação para o processamento de linguagem natural (PNL). (…)

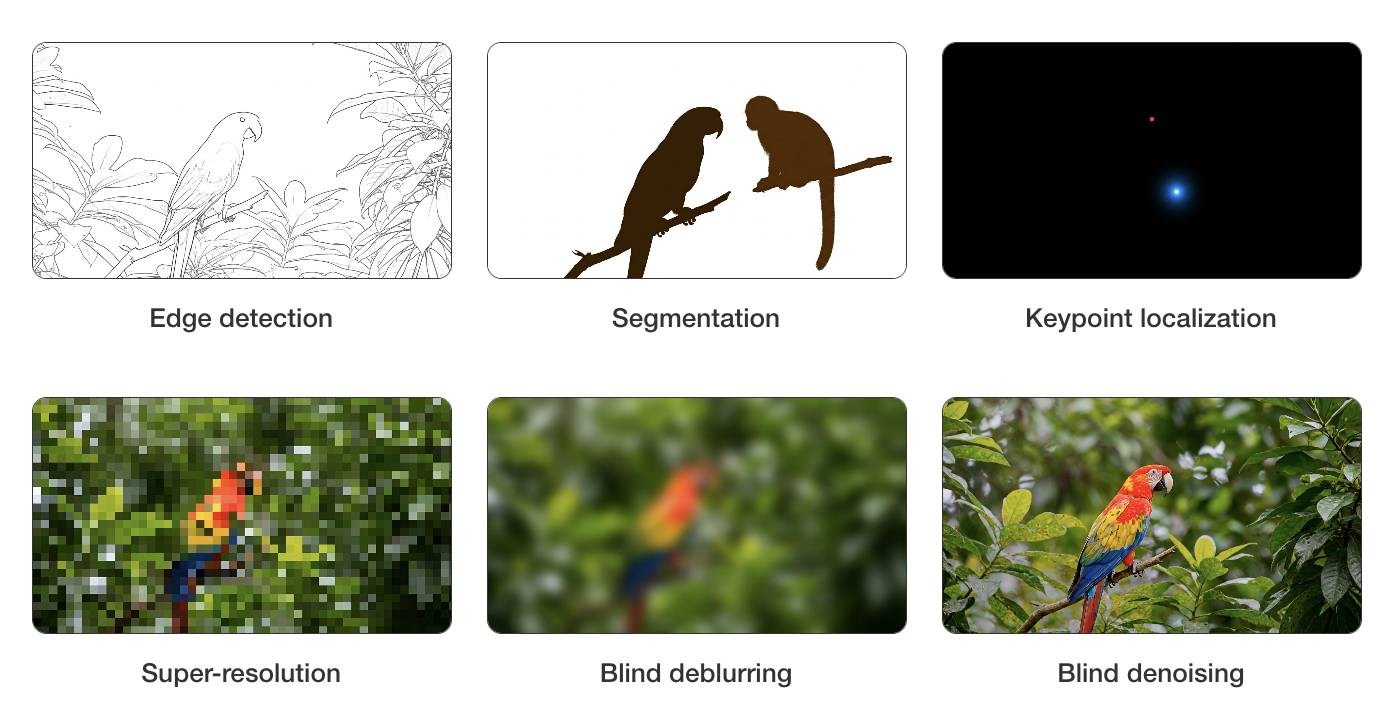

A Visão da Máquina hoje de várias maneiras se assemelha ao estado da PNL há alguns anos: existem excelentes modelos específicos de tarefas como “segmentar qualquer coisa” para segmentação ou variantes YOLO para detecção de objetos. Embora existam tentativas de unificar algumas tarefas de visão, nenhum modelo existente pode resolver qualquer problema apenas solicitando. No entanto, exatamente os mesmos primitivos que permitiram a aprendizagem zero na PNL também se aplicam aos modelos de vídeo generativos atuais-treinamento em escala de grande porte com um objetivo generativo (continuação de texto/vídeo) em dados em escala da Web. (…)

- Analisando 18.384 vídeos gerados em 62 tarefas qualitativas e 7 de tarefas quantitativas, relatamos que o VEO 3 pode resolver uma ampla gama de tarefas para as quais não foi treinado nem adaptado.

- Com base em sua capacidade de perceber, modelar e manipular o mundo visual, o VEO 3 mostra formas iniciais de raciocínio visual de “cadeia de quadros (COF)”, como o labirinto e a resolução de simetria.

- Embora os modelos sob medida específicos de tarefas ainda superem um modelo de vídeo zero, observamos uma melhoria de desempenho substancial e consistente do VEO 2 para o VEO 3, indicando um rápido avanço nos recursos dos modelos de vídeo.

Gostei particularmente da maneira como a cunhada o novo termo cadeia de quadros refletir a cadeia de pensamento no LLMS. Uma cadeia de quadros é como um modelo de geração de vídeo pode “raciocinar” sobre o mundo visual:

PercepçãoAssim, modelageme manipulação tudo se integra para enfrentar raciocínio visual. Enquanto os modelos de idiomas manipulam símbolos inventados por humanos, os modelos de vídeo podem aplicar mudanças nas dimensões do mundo real: tempo e espaço. Como essas mudanças são aplicadas quadro a quadro em um vídeo gerado, essa cadeia de pensamentos paralelos no LLMS e, portanto, pode ser chamada cadeia de quadrosou cof para abreviar. No domínio do idioma, a cadeia de pensamento permitiu que os modelos enfrentassem problemas de raciocínio. Da mesma forma, a cadeia de quadros (também conhecida como geração de vídeo) pode permitir que os modelos de vídeo resolvam problemas visuais desafiadores que exigem raciocínio passo a passo ao longo do tempo e do espaço.

Eles observam que, embora os modelos de vídeo permaneçam caros para funcionar hoje, é provável que eles sigam uma trajetória de preços semelhante à LLMS. Estou rastreando isso há alguns anos e é realmente uma enorme diferente-uma queda de 1.200x de preço entre o GPT-3 em 2022 (US $ 60/milhão de tokens) e o GPT-5-Nano hoje (US $ 0,05/milhão de tokens).

O PDF tem 45 páginas de comprimento, mas o papel principal é apenas as primeiras 9,5 páginas – o restante é principalmente apêndices. A leitura dessas primeiras 10 páginas fornecerá todos os detalhes do argumento deles.

O site que acompanha tem dezenas de demos de vídeo que valem a pena gastar algum tempo para ter uma ideia das diferentes aplicações do modelo VEO 3.

Vale a pena desviar os apêndices no papel também para ver exemplos de alguns dos avisos que eles usaram. Eles comparam alguns dos exercícios com tentativas equivalentes usando o modelo de geração de imagens de nano banana do Google.

Para detecção de borda, por exemplo:

Eu vejo: Todas as arestas nesta imagem se tornam mais salientes ao se transformar em contornos pretos. Então, todos os objetos desaparecem, com apenas as bordas restantes em um fundo branco. Perspectiva da câmera estática, sem zoom ou panela.

Nano Banana: Descreva todas as bordas da imagem em preto, faça tudo o mais branco.